Ngày nay, trí tuệ nhân tạo - AI đang hiện diện ở khắp mọi nơi, từ trung tâm dữ liệu đến những chiếc Mini PC trên bàn làm việc. Tại sự kiện Intel Vision 2024, Intel đã công bố chiến lược AI Everywhere đầy tham vọng, đặt AI làm trọng tâm trong mọi sản phẩm của hãng. Điều này đánh dấu một cuộc tái cấu trúc mạnh mẽ bên trong Intel nhằm thích nghi và dẫn đầu trong kỷ nguyên AI. Hãng không chỉ tái tổ chức các nhóm nghiên cứu, như hợp nhất mảng trung tâm dữ liệu với AI, mà còn đầu tư lớn vào các công nghệ then chốt, từ chip tăng tốc AI cho máy chủ đến bộ xử lý tích hợp AI cho Mini PC. Mục tiêu rõ ràng của Intel là đưa AI vào mọi thiết bị tính toán, với cam kết rằng sản phẩm của Intel sẽ có giá thành thấp hơn và hệ sinh thái thân thiện, mở hơn so với đối thủ.

Tái Cấu Trúc Để Cạnh Tranh Trong Kỷ Nguyên AI

Để bắt kịp xu hướng và cạnh tranh với những ông lớn như Nvidia, Intel đã tiến hành tái cơ cấu chiến lược một cách quyết liệt. Công ty tập trung nguồn lực vào AI nhiều hơn bao giờ hết, minh chứng là việc bổ nhiệm lãnh đạo mới và cắt giảm bộ máy cồng kềnh nhằm tăng tốc đổi mới. Intel định hướng đẩy nhanh nhịp độ phát triển chip AI, đặt mục tiêu mỗi năm ra mắt thế hệ chip AI mới giống như cách Nvidia đang làm, dù lộ trình này dự kiến phải tới khoảng năm 2027 mới hiện thực hóa được.

Đáng chú ý, Intel đã mạnh dạn cạnh tranh trực diện với Nvidia trên sân chơi AI. Họ giới thiệu dòng chip tăng tốc Gaudi thế hệ mới và thế hệ CPU Xeon có tích hợp AI, tập trung vào hiệu năng cao, chi phí thấp và tính mở. Chính chiến lược mở này giúp Intel thu hút sự quan tâm của các đối tác lớn, Intel hợp tác cùng Dell ra mắt giải pháp AI doanh nghiệp dùng Gaudi 3, tận dụng kết nối Ethernet tiêu chuẩn thay vì công nghệ độc quyền, giúp khách hàng linh hoạt triển khai AI mà không lo bị khóa chặt vào một nhà cung cấp. Các chuyên gia nhận định kế hoạch của Intel là khả thi nhưng cũng đầy thách thức, bởi Nvidia hiện chiếm tới 90% thị phần chip AI trung tâm dữ liệu. Tuy nhiên, với hướng đi AI mọi nơi và việc đồng loạt cải tiến từ tổ chức đến sản phẩm, Intel đang cho thấy quyết tâm lấy lại vị thế dẫn đầu trong kỷ nguyên AI.

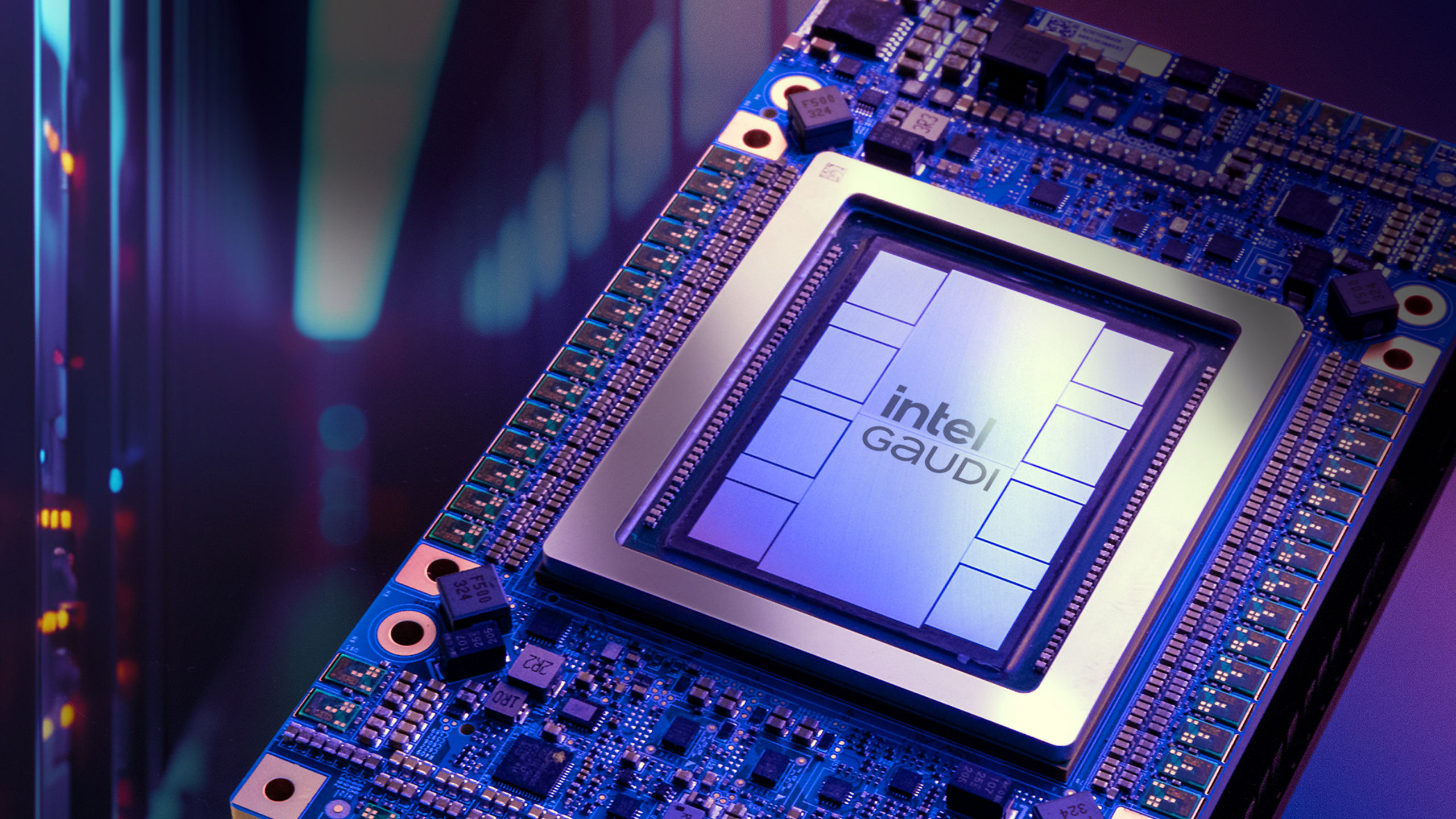

Xeon 6 và Gaudi 3 – Sức Mạnh AI Trong Trung Tâm Dữ Liệu

Hạ tầng trung tâm dữ liệu hiện đại tận dụng Intel Xeon thế hệ 6 và tăng tốc Gaudi 3 để tối ưu hiệu năng AI và hiệu quả năng lượng.

Trong mảng trung tâm dữ liệu, Intel đã tung ra những át chủ bài mới. Bộ vi xử lý Xeon Scalable Gen 6 và tăng tốc Gaudi 3. Đây là hai trụ cột giúp Intel hiện thực hóa chiến lược AI tại máy chủ doanh nghiệp. Xeon 6 được thiết kế chuyên biệt cho khối lượng công việc AI, với những bước nhảy vọt về phần cứng. Chip Xeon thế hệ 6 có số lõi xử lý tăng vọt – lên đến 144 lõi ở bản 6700 và 288 lõi ở bản 6900, cao gấp nhiều lần thế hệ trước. Nhờ đó, Intel tuyên bố hiệu năng xử lý tác vụ AI của Xeon 6 cao hơn 10 lần so với thế hệ tiền nhiệm. Mỗi lõi còn được tích hợp các động cơ tăng tốc AI chuyên dụng để tăng tốc tính toán ma trận, xử lý vector, những tác vụ cốt lõi trong huấn luyện và suy luận học máy. Không chỉ mạnh mẽ, Xeon 6 còn hướng tới hiệu quả năng lượng tốt hơn, với thiết kế nhân E-core tiết kiệm điện và cải thiện hiệu suất trên mỗi watt lên 2.4 lần so với thế hệ 4.

Intel khẳng định Xeon 6 là dòng CPU tốt nhất họ từng chế tạo dành cho workload AI, đạt mức tăng hiệu năng tới 40% trên phổ rộng các ứng dụng so với đời trước. Điều này biến Xeon 6 thành xương sống cho các trung tâm dữ liệu AI hiện đại, đáp ứng đồng thời các nhu cầu AI, điện toán hiệu năng cao và điện toán đám mây.

Bên cạnh CPU, Intel Gaudi 3 nổi lên như vũ khí giúp Intel cạnh tranh trực tiếp trong lĩnh vực tăng tốc AI chuyên dụng. Gaudi 3 là bộ tăng tốc AI thế hệ mới do Intel phát triển thông qua công nghệ của Habana Labs để đối đầu với GPU A100/H100 của Nvidia. Tại hội nghị Vision 2024, Intel tự tin so sánh Gaudi 3 với đối thủ: Chip này đạt hiệu năng suy luận cao hơn 50% và hiệu quả năng lượng tốt hơn 40% so với Nvidia H100, trong khi chi phí chỉ bằng một phần nhỏ của H100. Gaudi 3 được thiết kế tối ưu cho các mô hình học sâu khủng như các mô hình ngôn ngữ lớn (LLM), cho phép huấn luyện và suy luận nhanh hơn tới 50% ở nhiều tác vụ so với GPU hàng đầu hiện nay

Một điểm độc đáo của Gaudi 3 là Intel chọn hướng kết nối mở dựa trên Ethernet tiêu chuẩn thay vì công nghệ liên kết độc quyền. Gaudi 3 tích hợp sẵn các cổng Ethernet tốc độ 800 Gbps ngay trên bo mạch, cho phép kết nối trực tiếp cụm tăng tốc với băng thông cực cao. Điều này giúp mở rộng cụm tính toán AI dễ dàng bằng hạ tầng mạng phổ thông, tránh phụ thuộc vào các giải pháp độc quyền đắt đỏ. Thêm vào đó, hệ sinh thái phần mềm mở xung quanh Gaudi được Intel chú trọng: chip tương thích tốt với các framework phổ biến như TensorFlow, PyTorch và đi kèm bộ công cụ phát triển Habana SynapseAI. Theo Intel, nhờ cách tiếp cận mở này, Gaudi 3 đạt ưu thế 70% về thông lượng/giá khi chạy mô hình Llama 3 80 tỷ tham số so với Nvidia H100, một lợi thế lớn về chi phí cho doanh nghiệp.

Bộ Vi Xử Lý Intel Core Ultra Thế Hệ Arrow Lake Mang Sức Mạnh AI Lên PC Để Bàn, Hứa Hẹn Tạo Ra Thế Hệ Mini PC Thông Minh, Nhỏ Gọn.

Nếu như ở thượng tầng trung tâm dữ liệu, Intel có Xeon và Gaudi, thì ở phân khúc người dùng cá nhân, hãng cũng đang cách mạng hóa PC truyền thống bằng các bộ vi xử lý tích hợp AI. Hai thế hệ kiến trúc mới đáng chú ý là Arrow Lake và Lunar Lake – nền tảng cho dòng AI Mini PC sắp tới của Intel. Đây là những CPU Core thế hệ tiếp theo - dòng Core Ultra 14th/15th Gen được thiết kế với NPUtích hợp, giúp PC & PC Mini có khả năng xử lý các tác vụ AI ngay trên máy thay vì phụ thuộc hoàn toàn vào đám mây.

Arrow Lake đánh dấu lần đầu tiên Intel đưa nhân AI chuyên dụng vào CPU máy bàn. Arrow Lake trang bị NPU thế hệ 3 với hiệu suất khoảng 13 TOPS. Mặc dù 13 TOPS chưa phải quá cao so với tiêu chuẩn AI đồ họa chuyên nghiệp, nhưng sự hiện diện của NPU trên PC để bàn cho thấy Intel đang dọn đường cho các tính năng AI ngay trong những chiếc Mini PC hay desktop thông thường. Intel dự kiến sẽ xuất xưởng hơn 40 triệu PC có tích hợp AI trong năm 2024, cho thấy xu hướng AI PC sẽ sớm trở nên phổ biến. Thực tế, Arrow Lake ưu tiên cân bằng giữa AI và hiệu năng tổng thể: thay vì tích hợp NPU quá mạnh chiếm diện tích lớn, Intel chọn phương án dùng lại thiết kế NPU hiện có nhằm giữ nguyên số lượng nhân CPU và hiệu năng GPU cho game thủ và người dùng chuyên nghiệp

Sự xuất hiện của Arrow Lake và Lunar Lake báo hiệu kỷ nguyên PC thông minh. Đặc biệt, dòng Mini PC sẽ hưởng lợi lớn từ làn sóng AI này. Nhờ CPU tích hợp NPU và GPU cải tiến, Mini PC nay có thể đảm nhiệm những tác vụ AI vốn trước đây đòi hỏi máy trạm lớn. Chẳng hạn, ASUS NUC 14 Pro AI Mini PC sở hữu tới 6 engine AI chuyên dụng và có thể đạt tổng cộng 120 TOPS hiệu suất AI, đủ sức chạy mượt các mô hình học sâu cơ bản. Thiết bị Mini PC này còn tích hợp sẵn các tối ưu như OpenVINO toolkit để tăng tốc suy luận AI, giúp giảm độ trễ và tăng thông lượng xử lý ngay trên máy.

Điều này đồng nghĩa một Mini PC tích hợp AI có thể thực hiện nhanh các nhiệm vụ như phân tích hình ảnh camera, nhận dạng tiếng nói, hoặc chạy trợ lý ảo cá nhân… mà không cần đến server đám mây, bảo vệ tính riêng tư và tiết kiệm băng thông.

Lợi Ích Nổi Bật Của Mini PC Tích Hợp AI

Mini PC tích hợp chip Intel thế hệ mới có đủ sức mạnh AI để đảm nhiệm từ tác vụ văn phòng thông minh đến chạy mô hình học máy nhỏ. Hiệu suất AI nội tại (vài chục đến hàng trăm TOPS) cho phép thiết bị phản hồi nhanh với các tính năng như dịch thuật theo thời gian thực, xử lý ảnh bằng ML ngay trên máy…

So với việc đầu tư một dàn máy trạm hoặc GPU rời đắt tiền, Mini PC AI là giải pháp tiết kiệm chi phí hơn cho cả người dùng phổ thông lẫn doanh nghiệp nhỏ. Intel tập trung tối ưu hiệu năng trên mỗi watt trên các CPU/NPU mới, giúp mini PC vận hành êm ái, tiêu thụ điện thấp nhưng vẫn gánh được workload AI vừa phải. Đồng thời, giá thành phần cứng dự kiến dễ tiếp cận hơn so với các giải pháp AI chuyên dụng của đối thủ.

Không cần thiết bị ngoại vi cồng kềnh, AI được tích hợp sẵn trên chip của Mini PC. Người dùng có thể tận hưởng các tính năng AI ngay khi mở máy – từ bảo mật thông minh bằng nhận diện khuôn mặt, khử ồn âm thanh bằng machine learning, cho đến các tiện ích như tự động tóm tắt văn bản. Đối với chuyên gia, việc có NPU tích hợp giúp dễ dàng phát triển và thử nghiệm mô hình AI nhỏ ngay trên PC cá nhân.

Hệ sinh thái phần mềm phong phú: Intel thúc đẩy một hệ sinh thái mở cho AI PC. Bộ công cụ oneAPI và OpenVINO hỗ trợ lập trình đa kiến trúc CPU, GPU, NPU giúp nhà phát triển tối ưu ứng dụng AI dễ dàng trên phần cứng Intel. Các framework phổ biến như PyTorch, TensorFlow cũng được tối ưu cho phần cứng Intel, nhờ đó Mini PC AI có thể chạy tốt các ứng dụng và mô hình có sẵn mà cộng đồng đang sử dụng

Intel đang đưa AI đến gần hơn với người dùng phổ thông thông qua việc tích hợp sâu vào PC và mini PC. Với hiệu năng ngày càng cao và chi phí ngày càng thấp, những chiếc máy tính nhỏ gọn trong tương lai gần sẽ có khả năng học và hiểu nhu cầu người dùng tốt hơn, biến các ý tưởng như trợ lý ảo cá nhân, nhà thông minh... thành hiện thực dễ dàng.

Kết Luận: Intel Và Hành Trình AI Everywhere

Chiến lược AI đột phá của Intel thể hiện ở tầm nhìn AI ở khắp nơi, từ trung tâm dữ liệu đến thiết bị cá nhân, đang định hình lại vai trò của hãng trong ngành. Intel cho thấy họ sẵn sàng cải tổ toàn diện để thích nghi: từ việc tái cơ cấu nội bộ, đầu tư sản xuất chip tiên tiến, cho đến việc ra mắt loạt sản phẩm từ máy chủ đến PC đều xoay quanh trục AI. Hãng cũng nhấn mạnh triết lý mở, kết hợp phần cứng mạnh mẽ với hệ sinh thái phần mềm linh hoạt, chi phí hợp lý, nhằm thu hút cả giới chuyên gia công nghệ lẫn người dùng phổ thông. Dù còn nhiều thách thức phía trước trong cuộc đua với các đối thủ sừng sỏ, Intel đang dần khẳng định vai trò người dẫn dắt xu hướng AI mới. Tầm nhìn AI Everywhere không chỉ là khẩu hiệu, nó đang được hiện thực hóa qua từng dòng chip và chiếc Mini PC thông minh, đưa sức mạnh AI đến với mọi người, mọi nhà một cách gần gũi và hiệu quả hơn bao giờ hết.

Chủ đề Hot

Chủ đề Hot

Viết bình luận

Bình luận

Hiện tại bài viết này chưa có bình luận.